¿Alguna vez te has preguntado qué ocurre realmente cuando escribes una URL y cargas una web en segundos? Detrás de ese gesto cotidiano hay una coreografía bastante sofisticada. Google Cloud está diseñado precisamente para que todo eso funcione sin que lo notes.

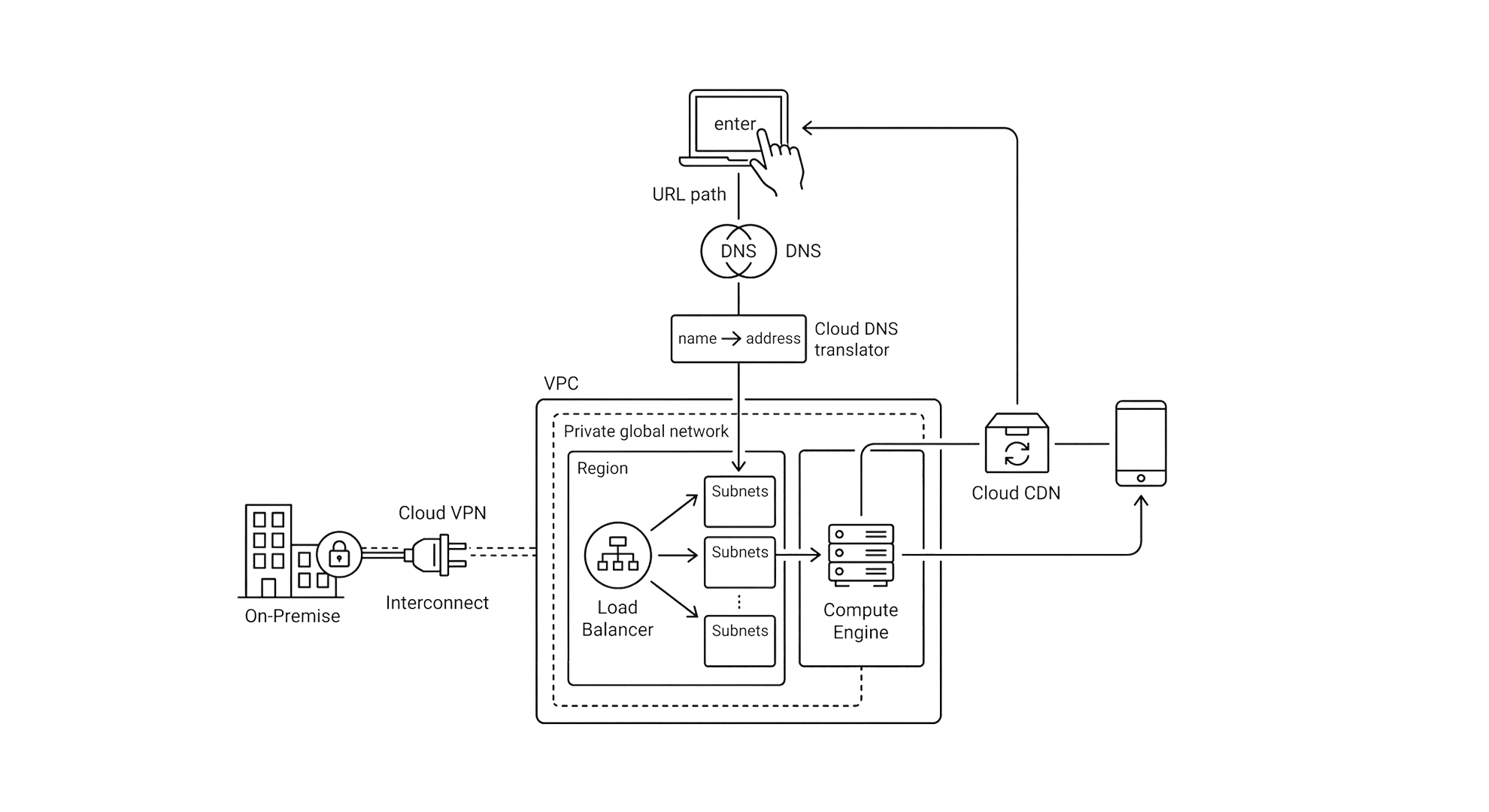

Empieza por algo invisible: la red. En Google Cloud, todo vive dentro de una VPC, una red privada global. Es “global” porque no está limitada a una región, pero se organiza en subredes regionales. Esto permite algo clave: diseñar arquitecturas distribuidas sin tener que reconstruir la red cada vez que creces.

Dentro de esa red viven las máquinas. Compute Engine es el servicio que te permite crear VMs, es decir, servidores virtuales con CPU, memoria y disco. Puedes elegir configuraciones estándar o diseñarlas a medida. Y si la carga sube, el sistema puede crear más instancias automáticamente. Si baja, las elimina. Escalas sin tocar nada.

Ahora bien, tener servidores no basta. Hay que decidir quién recibe cada petición. Ahí entra el Load Balancer. Google ofrece balanceo global: una única IP puede dirigir tráfico a múltiples regiones. Además, usa Anycast, lo que significa que el usuario entra siempre por el punto más cercano. Resultado: menos latencia sin esfuerzo.

Antes de eso, hay otra pieza crítica: el DNS. Cloud DNS traduce nombres como “tusitio.com” en direcciones IP. Es rápido, global y altamente disponible. Sin esto, internet no sería usable.

Y para acelerar aún más, aparece el CDN. Aquí la idea es simple: guardar copias del contenido cerca del usuario. Si alguien en Madrid pide una imagen, no tiene sentido traerla desde Estados Unidos cada vez. Se sirve desde el “edge”, reduciendo tiempo y coste.

Hasta aquí todo ocurre dentro de Google. Pero el mundo real no está aislado. Necesitas conectar tu infraestructura con otras redes. Puedes hacerlo con una VPN, que es un túnel cifrado sobre internet. Es flexible, pero depende de la red pública. Si necesitas más rendimiento o estabilidad, usas Interconnect: conexiones privadas, físicas o a través de proveedores.

Al final, todo encaja como un flujo continuo. El usuario pide una web. El DNS responde. El Load Balancer decide. El CDN acelera. Las VMs ejecutan. La red conecta todo.

La idea clave es esta: no estás gestionando servidores, estás diseñando sistemas distribuidos donde red, cómputo y tráfico trabajan como una sola unidad.

Y cuando lo ves así, la nube deja de ser “ordenadores en otro sitio” y pasa a ser una arquitectura pensada para escalar sin fricción.

Apoya este blog

Si quieres apoyar el blog con una aportación.

Deja una respuesta

Lo siento, debes estar conectado para publicar un comentario.