Durante mucho tiempo, la productividad digital se ha medido en términos de velocidad: escribir más rápido, producir más contenido, responder antes. La IA generativa parecía encajar perfectamente en esa lógica. Pero esa visión se queda corta. El cambio real no está en hacer lo mismo más deprisa, sino en hacer cosas distintas: reorganizar cómo se trabaja, cómo se decide y cómo fluye la información dentro de un proceso.

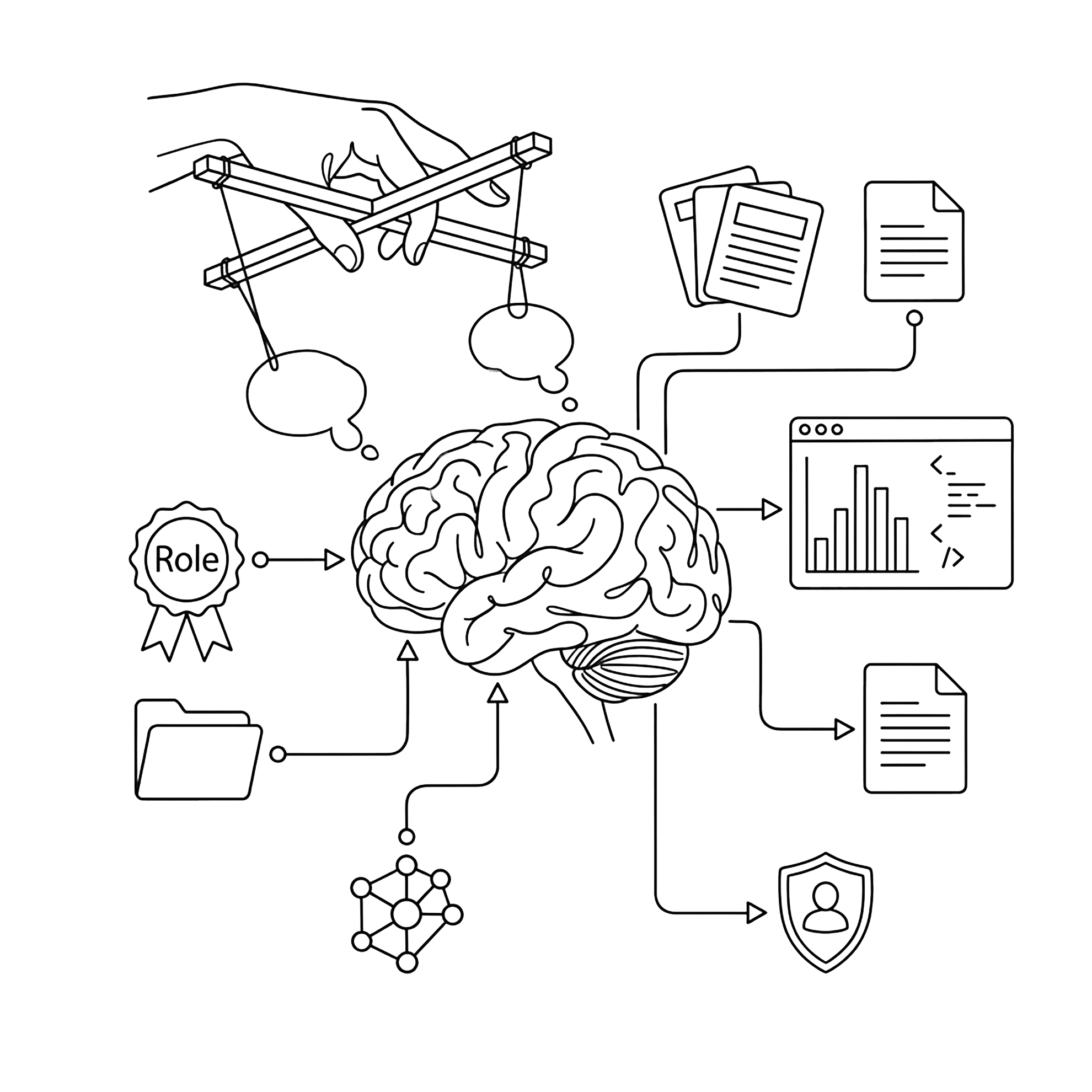

El punto de entrada a este cambio sigue siendo el prompting, pero entendido con más profundidad. Un prompt no es solo una instrucción, es una forma de estructurar el pensamiento. Cuando se usa sin contexto —lo que se conoce como zero-shot— la respuesta suele ser aceptable pero genérica. A medida que se introducen ejemplos o se define un rol claro, el modelo gana consistencia porque se reduce la ambigüedad. Sin embargo, el salto importante llega con el encadenamiento de prompts: dividir una tarea compleja en pasos, donde cada salida alimenta la siguiente. En ese momento, la IA deja de ser un generador puntual y empieza a comportarse como un sistema de trabajo.

Ese mismo principio es el que permite escalar el uso de la IA. El problema de muchos usuarios no es la capacidad de la herramienta, sino la falta de repetibilidad. Si cada interacción empieza desde cero, no hay aprendizaje acumulado. Aquí entran conceptos como plantillas, contexto persistente o asistentes personalizados. No son mejoras superficiales: convierten el uso de la IA en algo estructurado, donde ciertas decisiones ya están predefinidas y el esfuerzo cognitivo se reduce. La IA empieza a parecerse más a un proceso que a una conversación.

La fiabilidad introduce otra capa crítica. Los modelos generan respuestas plausibles, pero no siempre correctas. Para resolverlo, se han desarrollado enfoques como el grounding y el RAG. Ambos parten de la misma idea: conectar la generación con información verificable. En lugar de confiar en lo que el modelo “recuerda”, se le proporciona contexto externo en tiempo real. Esto cambia el rol del modelo: deja de ser una fuente de conocimiento y pasa a ser un motor que organiza y explica información. El resultado no es solo mayor precisión, sino también mayor control sobre lo que se está produciendo.

Herramientas como NotebookLM representan bien este cambio de paradigma. En lugar de partir de un modelo generalista, sitúan los documentos del usuario en el centro. La IA no inventa contexto, trabaja sobre uno definido. Esto permite resumir, cruzar información o generar preguntas con un nivel de trazabilidad que antes era difícil de conseguir. En entornos donde la decisión importa —investigación, estrategia, análisis— esta diferencia es fundamental: no se trata de generar más texto, sino de entender mejor el que ya existe.

Al mismo tiempo, la integración de modelos en herramientas cotidianas está desplazando el uso de la IA hacia dentro de los flujos de trabajo. Cuando aparece en editores de texto, sistemas de datos o entornos de desarrollo, deja de ser una herramienta externa. Se convierte en una capa adicional dentro de procesos ya existentes. Esto reduce la fricción de uso y, sobre todo, permite que la IA actúe en el momento en que se necesita, no después.

Aplicar todo esto no consiste en acumular herramientas, sino en alinear cada necesidad con un enfoque concreto. Las tareas abiertas y exploratorias se benefician de iteración y encadenamiento; las tareas repetitivas requieren estructura y reutilización; el análisis de información exige contexto controlado; y el trabajo con datos o código necesita integración directa con los sistemas donde ya ocurre ese trabajo. La diferencia no está en qué herramienta usas, sino en cómo encaja dentro de un flujo coherente.

La idea que emerge es clara: la IA generativa no redefine la productividad porque produzca más contenido, sino porque reorganiza el trabajo alrededor de sistemas asistidos. Cuando se usa bien, reduce la carga de decidir cada paso desde cero y permite centrarse en lo que realmente aporta valor.

La conclusión es directa. El siguiente nivel no es dominar prompts, sino diseñar procesos donde la IA forme parte de la lógica del trabajo. En ese punto, deja de ser una ayuda puntual y se convierte en infraestructura cognitiva.

Glosario

Zero-shot: uso de un modelo sin ejemplos previos en el prompt, confiando únicamente en la instrucción directa.

Few-shot: técnica que incluye ejemplos en el prompt para guiar el comportamiento del modelo.

Prompt chaining: encadenamiento de múltiples prompts donde cada resultado alimenta el siguiente paso.

Grounding: técnica que vincula las respuestas del modelo a fuentes externas verificables.

RAG (Retrieval-Augmented Generation): método que combina recuperación de información externa con generación de texto para mejorar precisión y contexto.

Apoya este blog

Si quieres apoyar el blog con una aportación.

Deja una respuesta

Lo siento, debes estar conectado para publicar un comentario.