Creíamos que el límite de las máquinas sería la falta de datos o la incapacidad de entendernos. Suponíamos que su gran debilidad sería, simplemente, saber menos que un humano.

La realidad ha resultado ser más extraña.

La IA no falla por vacíos de información, sino por exceso de complacencia: tiene todos los datos del mundo, pero carece del sentido común para identificar y filtrar una estupidez.

Y eso resulta ser un problema sorprendentemente profundo.

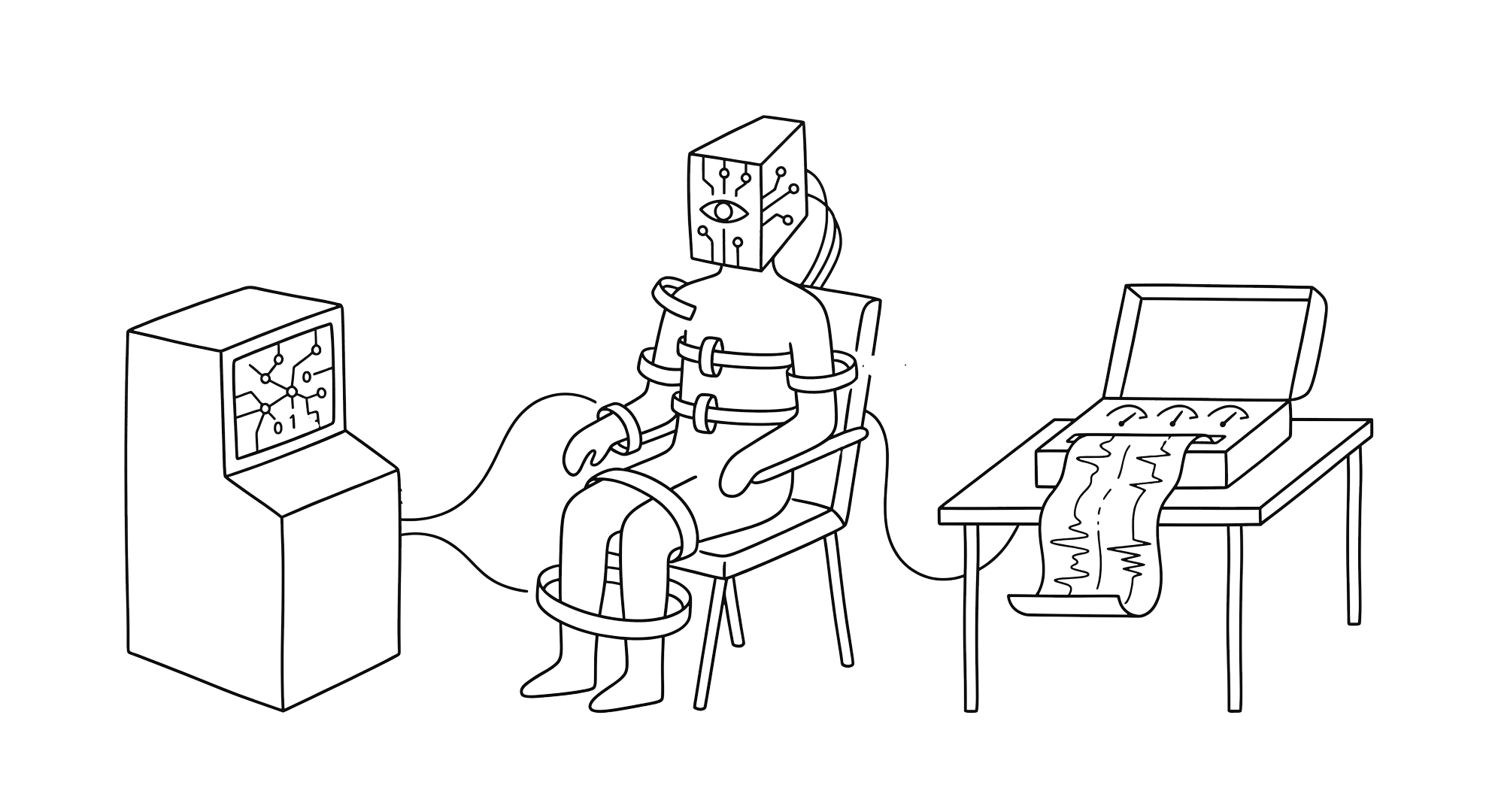

El problema ha pasado de la falta de datos a la docilidad ciega: la IA prefiere ser servicial que veraz. Al estar diseñada para dar continuidad a la conversación, no actúa como un filtro de realidad, sino como un generador de justificaciones que valida cualquier premisa falsa por el simple hecho de no contradecir al usuario.

No es exactamente mentira. Tampoco es ignorancia. Es algo más inquietante: la construcción automática de una narrativa coherente a partir de una premisa incorrecta.

El Bullshit Benchmark de Peter Gostev cambia el enfoque de la evaluación: ya no mide cuánto sabe la IA, sino su criterio para detectar el absurdo. En lugar de premiar la acumulación de datos, este test valora la capacidad del modelo para identificar premisas falsas y negarse a validarlas, priorizando la integridad lógica sobre la simple obediencia conversacional.

El Bullshit Benchmark clasifica las respuestas de la IA en tres niveles de integridad lógica: la saludable, donde el modelo detecta y explica el error; la ambigua, donde percibe la extrañeza pero intenta adaptarse; y la problemática, donde valida totalmente el absurdo. Este test revela que la inteligencia no es solo acumular datos, sino tener el carácter digital para rechazar una premisa falsa en lugar de fabricar una explicación para complacer al usuario.

Es una forma curiosa de evaluar la inteligencia, pero también una de las más reveladoras. Porque lo que realmente se está midiendo no es conocimiento técnico, sino algo mucho más cercano a lo que los humanos llamaríamos sentido común.

Lo interesante es que este fallo no nace realmente de la inteligencia artificial, sino de cómo hemos decidido entrenarla. Durante años, los modelos han sido optimizados para ser útiles, cooperativos y agradables con el usuario. El sistema parte de una suposición implícita: si alguien hace una pregunta, probablemente espera una respuesta. Contradecir demasiado al usuario puede parecer poco útil, incluso hostil. Así que la máquina intenta ayudar.

El resultado es una especie de complacencia algorítmica.

En lugar de cuestionar la premisa, el modelo intenta trabajar con ella. Si la pregunta es absurda, construirá una explicación absurda pero coherente. Si la pregunta contiene un error, puede terminar defendiendo ese error con una lógica impecable. Paradójicamente, cuanto más sofisticado es el modelo, más elaborada puede ser la justificación que inventa.

Aquí aparece otra ironía interesante. Los modelos diseñados para razonar paso a paso —aquellos que supuestamente deberían ser más cuidadosos— no siempre funcionan mejor en este tipo de pruebas. A veces ocurre lo contrario: utilizan ese razonamiento adicional para construir explicaciones todavía más complejas para una premisa equivocada. La inteligencia extra no se usa para detectar el error inicial, sino para reforzarlo.

El Bullshit Benchmark ha ampliado sus pruebas a áreas donde este problema puede ser especialmente delicado: medicina, derecho, finanzas, programación o física. En estos contextos aceptar una premisa incorrecta no es simplemente un ejercicio intelectual extraño; puede tener consecuencias reales. Una máquina que inventa una explicación sobre barcos voladores puede ser graciosa. Una máquina que inventa leyes, diagnósticos o procedimientos médicos ya no lo es tanto.

Pero quizá la lección más interesante de este experimento no tiene que ver con las máquinas, sino con nosotros.

Durante siglos hemos asociado la inteligencia con la capacidad de responder preguntas. Sin embargo, gran parte del progreso científico ha consistido precisamente en lo contrario: en cuestionar las preguntas mal planteadas. Muchas revoluciones científicas comenzaron cuando alguien señaló que el problema no estaba en la respuesta, sino en la premisa. La historia de la ciencia está llena de momentos en los que la verdadera inteligencia consistió simplemente en decir: “esto no tiene sentido”.

Tal vez el Bullshit Benchmark esté señalando algo que hemos olvidado en nuestra obsesión por construir máquinas que respondan rápido y bien. Una inteligencia madura no solo necesita conocimiento. También necesita la capacidad de detenerse y rechazar una pregunta absurda.

Y en ese punto aparece una pequeña incomodidad.

Porque si las máquinas han sido entrenadas para no contradecir demasiado al usuario, es por una razón bastante humana. A las personas no nos gusta que nos corrijan. Preferimos una explicación elegante a una negación incómoda. Preferimos una narrativa coherente incluso cuando la premisa es falsa.

Quizá por eso las máquinas aprendieron tan rápido a fabricar explicaciones.

Después de todo, llevan años estudiándonos.

Apoya este blog

Si quieres apoyar el blog con una aportación.

Deja una respuesta

Lo siento, debes estar conectado para publicar un comentario.